Incorporación de gráficos de conocimiento - Knowledge graph embedding

En el aprendizaje de representación , la incrustación de gráficos de conocimiento ( KGE ), también conocida como aprendizaje de representación de conocimientos ( KRL ), o aprendizaje de múltiples relaciones , es una tarea de aprendizaje automático de aprender una representación de baja dimensión de las entidades y relaciones de un gráfico de conocimiento mientras preservando su significado semántico . Aprovechando su representación incorporada , los gráficos de conocimiento (KG) se pueden utilizar para diversas aplicaciones, como la predicción de enlaces , la clasificación triple , el reconocimiento de entidades , la agrupación en clústeres y la extracción de relaciones .

Definición

Un gráfico de conocimiento es una colección de entidades , relaciones y hechos . Un hecho es un triple que denota un vínculo entre la cabeza y la cola del triple. Otra notación que se utiliza a menudo en la literatura para representar un triple (o hecho) es . Esta notación se denomina marco de descripción de recursos (RDF). Un gráfico de conocimiento representa el conocimiento relacionado con un dominio específico; Aprovechando esta representación estructurada, es posible inferir un nuevo conocimiento de ella después de algunos pasos de refinamiento. Sin embargo, hoy en día, las personas tienen que lidiar con la escasez de datos y la ineficiencia computacional para usarlos en una aplicación del mundo real.

La incrustación de un gráfico de conocimiento traduce cada entidad y relación de un gráfico de conocimiento en un vector de una dimensión determinada , denominada dimensión de incrustación. En el caso general, podemos tener diferentes dimensiones de incrustación para las entidades y las relaciones . La colección de vectores de incrustación para todas las entidades y relaciones en el gráfico de conocimiento es una representación más densa y eficiente del dominio que se puede usar más fácilmente para muchas tareas diferentes.

La incrustación de un gráfico de conocimiento se caracteriza por cuatro aspectos diferentes:

- Espacio de representación: el espacio de baja dimensión en el que se representan las entidades y relaciones.

- Función de puntuación: una medida de la bondad de una representación triple incrustada.

- Modelos de codificación: La modalidad en la que la representación incrustada de las entidades y relaciones interactúan entre sí.

- Información adicional: cualquier información adicional proveniente del gráfico de conocimiento que pueda enriquecer la representación incrustada. Por lo general, se integra una función de puntuación ad hoc en la función de puntuación general para cada información adicional.

Procedimiento de incrustación

Todos los diferentes modelos de incrustación de gráficos de conocimiento siguen aproximadamente el mismo procedimiento para aprender el significado semántico de los hechos. En primer lugar, para aprender una representación incrustada de un gráfico de conocimiento, los vectores incrustados de las entidades y relaciones se inicializan a valores aleatorios. Luego, a partir de un conjunto de entrenamiento hasta que se alcanza una condición de parada, el algoritmo optimiza continuamente las incorporaciones. Por lo general, la condición de parada viene dada por el sobreajuste sobre el conjunto de entrenamiento. Para cada iteración, se muestrea un lote de tamaño del conjunto de entrenamiento, y para cada triple del lote se muestrea un hecho aleatorio corrupto, es decir, un triple que no representa un hecho verdadero en el gráfico de conocimiento. La corrupción de un triple implica sustituir la cabeza o la cola (o ambas) del triple por otra entidad que hace que el hecho sea falso. El triple original y el triple dañado se agregan al lote de entrenamiento y luego se actualizan las incrustaciones, optimizando una función de puntuación. Al final del algoritmo, las incorporaciones aprendidas deberían haber extraído el significado semántico de las triples y deberían haber ocultado correctamente los hechos verdaderos en el gráfico de conocimiento.

Pseudocódigo

El siguiente es el pseudocódigo para el procedimiento de incrustación general.

algorithm Compute entity and relation embeddings is

input: The training set ,

entity set ,

relation set ,

embedding dimension

output: Entity and relation embeddings

initialization: the entities and relations embeddings (vectors) are randomly initialized

while stop condition do

// From the training set randomly sample a batch of size b

for each in do

// sample a corrupted fact or triple

end for

Update embeddings by minimizing the loss function

end while

Indicadores de desempeño

Estos índices se utilizan a menudo para medir la calidad de incrustación de un modelo. La simplicidad de los índices los hace muy adecuados para evaluar el rendimiento de un algoritmo de incrustación incluso a gran escala. Dado como el conjunto de todas las predicciones clasificadas de un modelo, es posible definir tres índices de rendimiento diferentes: Hits @ K, MR y MRR.

Éxitos @ K

Hits @ K o, en resumen, H @ K, es un índice de rendimiento que mide la probabilidad de encontrar la predicción correcta en las primeras predicciones del modelo K superior. Por lo general, se usa . Hits @ K refleja la precisión de un modelo de incrustación para predecir correctamente la relación entre dos triples dados.

Éxitos @ K

Los valores más grandes significan mejores rendimientos predictivos.

Rango medio (MR)

El rango medio es la posición de clasificación promedio de los elementos predichos por el modelo entre todos los elementos posibles.

Cuanto menor sea el valor, mejor será el modelo.

Rango recíproco medio (MRR)

El rango recíproco medio mide el número de triples predichos correctamente. Si el primer triple predicho es correcto, entonces se suma 1, si el segundo es correcto se suma, y así sucesivamente.

El rango recíproco medio se utiliza generalmente para cuantificar el efecto de los algoritmos de búsqueda.

Cuanto mayor sea el índice, mejor será el modelo.

Aplicaciones

Tareas de aprendizaje automático

Completar el gráfico de conocimiento (KGC) es una colección de técnicas para inferir conocimiento a partir de una representación de gráfico de conocimiento integrado. En particular, esta técnica completa un triple inferir la entidad o relación que falta. Las subtareas correspondientes se denominan predicción de enlace o entidad (es decir, adivinar una entidad de la incrustación dada la otra entidad del triple y la relación) y predicción de relación (es decir, pronosticar la relación más plausible que conecta dos entidades).

La clasificación triple es un problema de clasificación binaria. Dado un triple, el modelo entrenado evalúa la plausibilidad del triple utilizando la incrustación para determinar si un triple es verdadero o falso. La decisión se toma con la función de puntuación del modelo y un umbral determinado. La agrupación en clústeres es otra aplicación que aprovecha la representación incrustada de un gráfico de conocimiento escaso para condensar la representación de entidades semánticas similares cercanas en un espacio 2D.

Aplicaciones de palabras reales

El uso de la incrustación de gráficos de conocimiento es cada vez más generalizado en muchas aplicaciones. En el caso de los sistemas de recomendación , el uso de la incrustación de gráficos de conocimiento puede superar las limitaciones del aprendizaje reforzado habitual . La formación de este tipo de sistema de recomendación requiere una gran cantidad de información por parte de los usuarios; sin embargo, las técnicas de gráficos de conocimiento pueden abordar este problema mediante el uso de un gráfico ya construido sobre un conocimiento previo de la correlación de elementos y el uso de la incrustación para inferir la recomendación. La reutilización de medicamentos es el uso de un medicamento ya aprobado, pero con un propósito terapéutico diferente al que fue diseñado inicialmente. Es posible utilizar la tarea de predicción de enlaces para inferir una nueva conexión entre un fármaco ya existente y una enfermedad mediante el uso de un gráfico de conocimiento biomédico construido aprovechando la disponibilidad de bibliografía masiva y bases de datos biomédicas. La incrustación de gráficos de conocimiento también se puede utilizar en el ámbito de la política social.

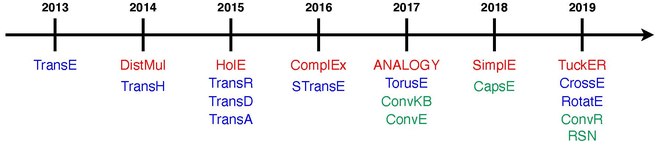

Modelos

Dada una colección de triples (o hechos) , el modelo de incrustación del gráfico de conocimiento produce, para cada entidad y relación presente en el gráfico de conocimiento, una representación vectorial continua. es la incrustación correspondiente de un triple con y , donde es la dimensión de incrustación para las entidades y para las relaciones. La función de puntuación de un modelo dado se denota y mide la distancia entre la incrustación de la cabeza y la incrustación de la cola dada la incrustación de la relación, o en otras palabras, cuantifica la plausibilidad de la representación incrustada de un hecho dado.

Rossi y col. proponen una taxonomía de los modelos de incrustación e identifica tres familias principales de modelos: modelos de descomposición de tensores, modelos geométricos y modelos de aprendizaje profundo.

Modelo de descomposición tensorial

La descomposición del tensor es una familia de modelos de incrustación de gráficos de conocimiento que utilizan una matriz multidimensional para representar un gráfico de conocimiento, que es parcialmente cognoscible debido a las lagunas del gráfico de conocimiento que describen un dominio en particular a fondo. En particular, estos modelos utilizan un tensor de tres vías (3D) , que luego se factoriza en vectores de baja dimensión que son las entidades y relaciones integradas. El tensor de tercer orden es una metodología adecuada para representar un grafo de conocimiento porque registra solo la existencia o ausencia de relación entre entidades, y por ello es simple, y no es necesario conocer a priori la estructura de la red, haciendo esta clase de modelos de incrustación es liviana y fácil de entrenar incluso si sufren de escasez de datos y de alta dimensión.

Modelos bilineales

Esta familia de modelos usa una ecuación lineal para incrustar la conexión entre las entidades a través de una relación. En particular, la representación incrustada de las relaciones es una matriz bidimensional. Estos modelos, durante el procedimiento de incrustación, solo usan los hechos individuales para calcular la representación incrustada e ignoran las otras asociaciones a la misma entidad o relación.

- DistMult : Dado que la matriz de incrustación de la relación es una matriz diagonal, la función de puntuación no puede distinguir hechos asimétricos.

- ComplEx : Como DistMult usa una matriz diagonal para representar las relaciones incrustadas, pero agrega una representación en el espacio vectorial complejo y el producto hermitiano , puede distinguir hechos simétricos y asimétricos. Este enfoque es escalable a un gran gráfico de conocimiento en términos de costo de tiempo y espacio.

- ANALOGÍA : Este modelo codifica en la incrustación de la estructura analógica del gráfico de conocimiento para simular el razonamiento inductivo. Usando una función objetivo diferenciable, ANALOGY tiene buena generalidad teórica y escalabilidad computacional. Está comprobado que la incrustación producida por ANALOGY recupera completamente la incrustación de DistMul, ComplEx y HolE.

- Sencillo : Este modelo es la mejora de la descomposición poliadica canónica (CPD), en la que se aprenden un vector de incrustación para la relación y dos vectores de incrustación independientes para cada entidad, dependiendo de si es una cabeza o una cola en el hecho del gráfico de conocimiento. SimplE resuelve el problema del aprendizaje independiente de las incorporaciones de dos entidades utilizando una relación inversa y promedia la puntuación CPD de y . De esta forma, SimplE recoge la relación entre entidades mientras aparecen en el rol de sujeto u objeto dentro de un hecho, y es capaz de incrustar relaciones asimétricas.

Modelos no bilineales

- HolE: HolE utiliza la correlación circular para crear una representación incrustada del gráfico de conocimiento, que puede verse como una compresión del producto de la matriz, pero es más eficiente y escalable desde el punto de vista computacional, al tiempo que mantiene las capacidades para expresar una relación asimétrica, ya que la correlación circular no es conmutativa. . HolE vincula las incrustaciones holográficas y complejas ya que, si se usa junto con Fourier , puede verse como un caso especial de ComplEx.

- TuckER: TuckER ve el gráfico de conocimiento como un tensor que podría descomponerse utilizando la descomposición de Tucker en una colección de vectores, es decir, las incrustaciones de entidades y relaciones, con un núcleo compartido. Los pesos del tensor central se aprenden junto con las incrustaciones y representan el nivel de interacción de las entradas. Cada entidad y relación tiene su propia dimensión de incrustación, y el tamaño del tensor central está determinado por la forma de las entidades y relaciones que interactúan. La incrustación del sujeto y el objeto de un hecho se suma de la misma manera, lo que hace que TuckER sea completamente expresivo, y otros modelos de incrustación como RESCAL, DistMult, ComplEx y SimplE pueden expresarse como una formulación especial de TuckER.

Modelos geométricos

El espacio geométrico definido por esta familia de modelos codifica la relación como una transformación geométrica entre la cabeza y la cola de un hecho. Por esta razón, para calcular la incrustación de la cola, es necesario aplicar una transformación a la incrustación de la cabeza, y se usa una función de distancia para medir la bondad de la incrustación o para calificar la confiabilidad de un hecho.

Los modelos geométricos son similares al modelo de descomposición tensorial, pero la principal diferencia entre los dos es que deben preservar la aplicabilidad de la transformación en el espacio geométrico en el que se define.

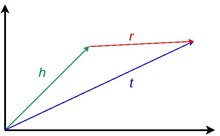

Modelos traslacionales puros

Esta clase de modelos se inspira en la idea de invariancia de traducción introducida en word2vec . Un modelo traslacional puro se basa en el hecho de que los vectores de incrustación de las entidades están cerca entre sí después de aplicar una traducción relacional adecuada en el espacio geométrico en el que están definidas. En otras palabras, dado un hecho, cuando se agrega la incrustación de la cabeza a la incrustación de la relación, el resultado esperado debería ser la incrustación de la cola. La cercanía de las entidades incrustadas viene dada por alguna medida de distancia y cuantifica la confiabilidad de un hecho.

- Transe : Este modelo utiliza una función de puntuación que las fuerzas de las inmersiones para satisfacer un simple suma vectorial ecuación en cada hecho en el que aparecen: . La incrustación será exacta si cada entidad y relación aparece en un solo hecho y, por esta razón, en la práctica no representa bien las relaciones uno a muchos , muchos a uno y asimétricas .

- TransH : Es una evolución de TransE introduciendo un hiperplano como espacio geométrico para resolver el problema de representar correctamente los tipos de relaciones. En TransH, cada relación tiene una representación incrustada diferente, en un hiperplano diferente, según las entidades con las que interactúa. Por lo tanto, para calcular, por ejemplo, la función de puntuación de un hecho, la representación incrustada de la cabeza y la cola debe proyectarse utilizando una matriz de proyección relacional en el hiperplano correcto de la relación.

- TransR : TransR es una evolución de TransH porque utiliza dos espacios diferentes para representar la representación incrustada de las entidades y las relaciones, y separa completamente el espacio semántico de entidades y relaciones. Además, TransR usa una matriz de proyección relacional para traducir la incrustación de las entidades al espacio de relación.

- TransD : Ante un hecho, en TransR, la cabeza y la cola de un hecho podrían pertenecer a dos tipos diferentes de entidades, por ejemplo, en el hecho , Obama y USA son dos entidades pero una es una persona y la otra es un país. . La multiplicación de matrices también es un procedimiento costoso en TransR para calcular la proyección. En este contexto, TransD emplea dos vectores para cada par entidad-relación para calcular un mapeo dinámico que sustituye a la matriz de proyección mientras reduce la complejidad dimensional. El primer vector se utiliza para representar el significado semántico de las entidades y relaciones, el segundo para calcular la matriz de mapeo.

- TransA: Todos los modelos traslacionales definen una función de puntuación en su espacio de representación, pero simplifican demasiado esta pérdida métrica. Dado que la representación vectorial de las entidades y relaciones no es perfecta, una traducción pura de podría estar distante y una distancia euclidiana equipotencial esférica hace que sea difícil distinguir cuál es la entidad más cercana. TransA, en cambio, introduce una distancia Mahalanobis adaptativa para ponderar las dimensiones de incrustación, junto con superficies elípticas para eliminar la ambigüedad.

Modelos traslacionales con incrustaciones adicionales

Es posible asociar información adicional a cada elemento en el gráfico de conocimiento y sus hechos de representación comunes. Cada entidad y relación se puede enriquecer con descripciones de texto, pesos, restricciones y otros para mejorar la descripción general del dominio con un gráfico de conocimiento. Durante la incrustación del gráfico de conocimiento, esta información se puede utilizar para aprender incrustaciones especializadas para estas características junto con la representación incrustada habitual de entidades y relaciones, con el costo de aprender un número más significativo de vectores.

- STransE: este modelo es el resultado de la combinación de TransE y de la estructura incrustada de tal manera que es capaz de representar mejor las relaciones uno a muchos, muchos a uno y muchos a muchos . Para hacerlo, el modelo involucra dos matrices independientes adicionales y para cada relación incrustada en el KG. Cada matriz adicional se utiliza basándose en el hecho de que la relación específica interactúa con la cabeza o la cola del hecho. En otras palabras, dado un hecho , antes de aplicar la traslación vectorial, la cabeza se multiplica por y la cola se multiplica por .

- CrossE : Las interacciones cruzadas se pueden utilizar para la selección de información relacionada y podrían ser muy útiles para el procedimiento de incrustación. Las interacciones cruzadas proporcionan dos contribuciones distintas en la selección de información: interacciones de relaciones a entidades e interacciones de entidades a relaciones. Esto significa que una relación, por ejemplo, 'presidente_de' selecciona automáticamente los tipos de entidades que están conectando al sujeto con el objeto de un hecho. De manera similar, la entidad de un hecho determina de manera indeterminada cuál es la ruta de inferencia que debe elegirse para predecir el objeto de un triple relacionado. CrossE, para hacerlo, aprende una matriz de interacción adicional , utiliza el producto por elementos para calcular la interacción entre y . Incluso si, CrossE, no se basa en una arquitectura de red neuronal, se demuestra que esta metodología se puede codificar en dicha arquitectura.

Modelos roto-traslacionales

Esta familia de modelos, además o en sustitución de una traslación, emplean una transformación similar a la rotación.

- TorusE: El término de regularización de TransE hace que la entidad se incruste para construir un espacio esférico y, en consecuencia, pierde las propiedades de traslación del espacio geométrico. Para abordar este problema, TorusE aprovecha el uso de un grupo de Lie compacto que en este caso específico es el espacio toroidal n-dimensional , y evita el uso de regularización. TorusE define las funciones de distancia para sustituir la norma L1 y L2 de TransE.

- RotatE: RotatE se inspira en la identidad de Euler e implica el uso del producto Hadmard para representar una relación como una rotación de la cabeza a la cola en el espacio complejo. Para cada elemento del triple, la parte compleja de la incrustación describe una rotación en sentido antihorario con respecto a un eje, que se puede describir con la identidad de Euler, mientras que el módulo del vector de relación es 1. Se muestra que el modelo es capaz de incrustación de relaciones simétricas, asimétricas, de inversión y de composición del gráfico de conocimiento.

Modelos de aprendizaje profundo

Este grupo de modelos de incrustación utiliza una red neuronal profunda para aprender patrones del gráfico de conocimiento que son los datos de entrada. Estos modelos tienen la generalidad de distinguir el tipo de entidad y relación, información temporal, información de ruta, información estructurada subyacente y resuelven las limitaciones de los modelos basados en distancia y basados en emparejamiento semántico en la representación de todas las características de un gráfico de conocimiento. El uso del aprendizaje profundo para la incrustación de gráficos de conocimiento ha demostrado un buen rendimiento predictivo, incluso si son más costosos en la fase de entrenamiento, están enojados con los datos y, a menudo, requieren una representación de incrustación preentrenada del gráfico de conocimiento que proviene de un modelo de incrustación diferente.

Redes neuronales convolucionales

Esta familia de modelos, en lugar de utilizar capas completamente conectadas, emplea una o más capas convolucionales que convolucionan los datos de entrada aplicando un filtro de baja dimensión capaz de incrustar estructuras complejas con pocos parámetros mediante el aprendizaje de características no lineales.

- ConvE: ConvE es un modelo de incrustación que representa un buen equilibrio entre la expresividad de los modelos de aprendizaje profundo y el costo computacional; de hecho, se muestra que utilizó 8 veces menos parámetros, en comparación con DistMult. ConvE utiliza una incrustación de tamaño unidimensional para representar las entidades y relaciones de un gráfico de conocimiento. Para calcular la función de puntuación de un triple, ConvE aplica un procedimiento simple: primero concatenar y fusionar las incrustaciones de la cabeza del triple y la relación en un solo dato , luego esta matriz se usa como entrada para la capa convolucional 2D. El resultado se pasa luego a través de una capa densa que aplica una transformación lineal parametrizada por la matriz y al final, con el producto interno se vincula al triple de la cola. ConvE también es particularmente eficiente en el procedimiento de evaluación: utilizando una puntuación 1-N, el modelo coincide, dada una cabeza y una relación, todas las colas al mismo tiempo, lo que ahorra mucho tiempo de evaluación en comparación con la evaluación 1-1. programa de los otros modelos.

- ConvR: ConvR es una red convolucional adaptativa destinada a representar en profundidad todas las posibles interacciones entre las entidades y las relaciones. Para esta tarea, ConvR, calcula un filtro convolucional para cada relación y, cuando es necesario, aplica estos filtros a la entidad de interés para extraer características convolucionales. El procedimiento para calcular la puntuación de triple es el mismo que el de ConvE.

- ConvKB: ConvKB, para calcular la función de puntuación de un triple dado , produce una entrada de dimensión sin remodelar y la pasa a una serie de filtro convolucional de tamaño . Este resultado alimenta una capa densa con una sola neurona que produce la puntuación final. La única neurona final hace de esta arquitectura un clasificador binario en el que el hecho puede ser verdadero o falso. Una diferencia con ConvE es que la dimensionalidad de las entidades no cambia.

Redes neuronales cápsula

Esta familia de modelos utiliza redes neuronales en cápsula para crear una representación más estable que es capaz de reconocer una característica en la entrada sin perder información espacial. La red está compuesta por capas convolucionales, pero están organizadas en cápsulas, y el resultado general de una cápsula se envía a una cápsula superior decidida por una rutina de proceso dinámico.

- CapsE: CapsE implementa una red de cápsulas para modelar un hecho . Al igual que en ConvKB, cada elemento triple se concatena para construir una matriz y se utiliza para alimentar una capa convolucional para extraer las características convolucionales. Estas características luego se redirigen a una cápsula para producir un vector continuo, cuanto más largo es el vector, más cierto es el hecho.

Redes neuronales recurrentes

Esta clase de modelos aprovecha el uso de redes neuronales recurrentes . La ventaja de esta arquitectura es memorizar una secuencia de hechos, en lugar de simplemente elaborar eventos individuales.

- RSN: Durante el procedimiento de incrustación, comúnmente se asume que entidades similares tienen relaciones similares. En la práctica, este tipo de información no se aprovecha, porque la incrustación se calcula solo sobre el hecho en cuestión en lugar de un historial de hechos. Las redes de omisión recurrente (RSN) utilizan una red neuronal recurrente para aprender la ruta relacional mediante un muestreo de recorrido aleatorio.

Rendimiento del modelo

La tarea de aprendizaje automático para la incrustación de gráficos de conocimiento que se utiliza con más frecuencia para evaluar la precisión de incrustación de los modelos es la predicción de enlaces. Rossi y col. produjo un extenso punto de referencia de los modelos, pero también otras encuestas producen resultados similares. El punto de referencia incluye cinco conjuntos de datos FB15k, WN18, FB15k-237, WN18RR y YAGO3-10. Más recientemente, se ha discutido que estos conjuntos de datos están lejos de las aplicaciones del mundo real, y otros conjuntos de datos deberían integrarse como un punto de referencia estándar.

| Nombre del conjunto de datos | Número de entidades diferentes | Número de relaciones diferentes | Número de triples |

|---|---|---|---|

| FB15k | 14951 | 1345 | 584,113 |

| WN18 | 40943 | 18 | 151,442 |

| FB15k-237 | 14541 | 237 | 310,116 |

| WN18RR | 40943 | 11 | 93,003 |

| YAGO3-10 | 123182 | 37 | 1.089.040 |

| Nombre del modelo | Complejidad de la memoria | FB15K (hits @ 10) | FB15K (Señor) | FB15K (MRR) | FB15K - 237 (hits @ 10) | FB15K - 237 (Señor) | FB15K - 237 (MRR) | WN18 (hits @ 10) | WN18 (Señor) | WN18 (MRR) | WN18RR (hits @ 10) | WN18RR (señor) | WN18RR (MRR) | YAGO3-10 (hits @ 10) | YAGO3-10 (Señor) | YAGO3-10 (MRR) |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| DistMul | 0,863 | 173 | 0,784 | 0.490 | 199 | 0.313 | 0,946 | 675 | 0,824 | 0.502 | 5913 | 0.433 | 0,661 | 1107 | 0.501 | |

| Complejo | 0,905 | 34 | 0,848 | 0.529 | 202 | 0.349 | 0,955 | 3623 | 0,949 | 0.521 | 4907 | 0,458 | 0,703 | 1112 | 0.576 | |

| ANALOGÍA | 0,837 | 126 | 0,726 | 0.353 | 476 | 0,202 | 0,944 | 808 | 0,934 | 0.380 | 9266 | 0.366 | 0,456 | 2423 | 0,283 | |

| Sencillo | 0,836 | 138 | 0,726 | 0.343 | 651 | 0,179 | 0,945 | 759 | 0,938 | 0,426 | 8764 | 0.398 | 0,631 | 2849 | 0.453 | |

| Agujero | 0,867 | 211 | 0,800 | 0,476 | 186 | 0.303 | 0,949 | 650 | 0,938 | 0.487 | 8401 | 0.432 | 0,651 | 6489 | 0.502 | |

| Fatigar | 0,888 | 39 | 0,788 | 0.536 | 162 | 0.352 | 0,958 | 510 | 0,951 | 0.514 | 6239 | 0,459 | 0,680 | 2417 | 0.544 | |

| TransE | 0,847 | 45 | 0,628 | 0,497 | 209 | 0.310 | 0,948 | 279 | 0,646 | 0,495 | 3936 | 0,206 | 0,673 | 1187 | 0.501 | |

| STransE | 0,796 | 69 | 0.543 | 0,495 | 357 | 0.315 | 0,934 | 208 | 0,656 | 0,422 | 5172 | 0,226 | 0.073 | 5797 | 0,049 | |

| CrossE | 0,862 | 136 | 0,702 | 0.470 | 227 | 0,298 | 0,950 | 441 | 0,834 | 0,449 | 5212 | 0,405 | 0,654 | 3839 | 0,446 | |

| TorusE | 0,839 | 143 | 0,746 | 0,447 | 211 | 0,281 | 0,954 | 525 | 0,947 | 0.535 | 4873 | 0,463 | 0,474 | 19455 | 0.342 | |

| Girar | 0,881 | 42 | 0,791 | 0.522 | 178 | 0.336 | 0,960 | 274 | 0,949 | 0.573 | 3318 | 0.475 | 0.570 | 1827 | 0,498 | |

| ConvE | 0,849 | 51 | 0,688 | 0.521 | 281 | 0.305 | 0,956 | 413 | 0,945 | 0,507 | 4944 | 0,427 | 0,657 | 2429 | 0,488 | |

| ConvKB | 0.408 | 324 | 0,211 | 0.517 | 309 | 0,230 | 0,948 | 202 | 0,709 | 0.525 | 3429 | 0,249 | 0,604 | 1683 | 0,420 | |

| ConvR | 0,885 | 70 | 0,773 | 0.526 | 251 | 0.346 | 0,958 | 471 | 0,950 | 0.526 | 5646 | 0,467 | 0,673 | 2582 | 0.527 | |

| CapsE | 0,217 | 610 | 0.087 | 0.356 | 405 | 0,160 | 0,950 | 233 | 0,890 | 0.559 | 720 | 0.415 | 0 | 60676 | 0.000 | |

| RSN | 0,870 | 51 | 0,777 | 0,444 | 248 | 0,280 | 0,951 | 346 | 0,928 | 0.483 | 4210 | 0.395 | 0,664 | 1339 | 0.511 |

Bibliotecas

- KGE en GitHub

- Pykg2vec en GitHub

- DGL-KE en GitHub

- PyKEEN en GitHub

- TorchKGE en GitHub

- AmpliGraph en GitHub

- OpenKE en GitHub

- scikit-kge en GitHub

- Fast-TransX en GitHub

Ver también

- Gráfico de conocimiento

- Incrustar

- Aprendizaje automático

- Base de conocimientos

- Extracción de conocimiento

- Aprendizaje relacional estadístico

- Aprendizaje de representación

- Incrustación de gráficos

Referencias

- ^ a b c d e f g h i j k l m n o p q r s t u v w x y z aa Ji, Shaoxiong; Pan, Shirui; Cambria, Erik; Marttinen, Pekka; Yu, Philip S. (2021). "Una encuesta sobre los gráficos de conocimiento: representación, adquisición y aplicaciones" . Transacciones IEEE en redes neuronales y sistemas de aprendizaje . PP : 1–21. arXiv : 2002.00388 . doi : 10.1109 / TNNLS.2021.3070843 . ISSN 2162-237X . PMID 33900922 . S2CID 211010433 .

- ^ Mohamed, Sameh K; Nováček, Vít; Sustantivo, Aayah (1 de agosto de 2019). Cowen, Lenore (ed.). "Descubrimiento de objetivos de fármacos proteicos mediante incrustaciones de gráficos de conocimiento" . Bioinformática . 36 (2): 603–610. doi : 10.1093 / bioinformatics / btz600 . hdl : 10379/15375 . ISSN 1367-4803 . PMID 31368482 .

- ^ a b c d Lin, Yankai; Han, Xu; Xie, Ruobing; Liu, Zhiyuan; Sun, Maosong (28 de diciembre de 2018). "Aprendizaje de representación del conocimiento: una revisión cuantitativa". arXiv : 1812.10901 [ cs.CL ].

- ^ a b c Abu-Salih, Bilal; Al-Tawil, Marwan; Aljarah, Ibrahim; Faris, Hossam; Wongthongtham, Pornpit; Chan, Kit Yan; Beheshti, Amin (12 de mayo de 2021). "Análisis de aprendizaje relacional de la política social mediante la incrustación de gráficos de conocimiento" . Minería de datos y descubrimiento de conocimientos . 35 (4): 1497-1536. arXiv : 2006.01626 . doi : 10.1007 / s10618-021-00760-w . ISSN 1573-756X .

- ^ a b c d e f g h i j k l m n o p q r s t u v w x y z aa ab ac ad ae af ag ah ai aj ak al am an ao ap aq ar como Rossi, Andrea; Barbosa, Denilson; Firmani, Donatella; Matinata, Antonio; Merialdo, Paolo (2020). "Embebido de gráficos de conocimiento para la predicción de enlaces: un análisis comparativo" . Transacciones de ACM sobre el descubrimiento de conocimientos a partir de datos . 15 (2): 1–49. arXiv : 2002.00819 . doi : 10.1145 / 3424672 . ISSN 1556-4681 . S2CID 211011226 .

- ↑ a b Paulheim, Heiko (6 de diciembre de 2016). Cimiano, Philipp (ed.). "Refinamiento del gráfico de conocimiento: una encuesta de enfoques y métodos de evaluación" . Web semántica . 8 (3): 489–508. doi : 10.3233 / SW-160218 .

- ^ a b c d e f g h i j k l m n o p q r s t u v w x y z aa ab ac Dai, Yuanfei; Wang, Shiping; Xiong, Neal N .; Guo, Wenzhong (mayo de 2020). "Una encuesta sobre la incrustación de gráficos de conocimiento: enfoques, aplicaciones y puntos de referencia" . Electrónica . 9 (5): 750. doi : 10.3390 / electronics9050750 .

- ^ Guo, Shu; Wang, Quan; Wang, Bin; Wang, Lihong; Guo, Li (2015). "Integración de gráficos de conocimiento semánticamente fluida" . Actas de la 53ª Reunión Anual de la Asociación de Lingüística Computacional y la 7ª Conferencia Conjunta Internacional sobre Procesamiento del Lenguaje Natural (Volumen 1: Artículos extensos) . Beijing, China: Asociación de Lingüística Computacional: 84–94. doi : 10.3115 / v1 / P15-1009 . S2CID 205692 .

- ^ a b c d e f g Bordes, Antoine; Usunier, Nicolás; García-Durán, Alberto; Weston, Jason; Yakhnenko, Oksana (mayo de 2013). "Traducción de incrustaciones para modelar datos multirrelacionales" . Actas de la 26a Conferencia Internacional sobre Sistemas de Procesamiento de Información Neural - Volumen 2 . NIPS'13. Lake Tahoe, Nevada: Curran Associates Inc .: 2787–2795.

- ^ a b c d e f g h i j k l Chen, Zhe; Wang, Yuehan; Zhao, Bin; Cheng, Jing; Zhao, Xin; Duan, Zongtao (2020). "Finalización del gráfico de conocimiento: una revisión" . Acceso IEEE . 8 : 192435–192456. doi : 10.1109 / ACCESS.2020.3030076 . ISSN 2169-3536 . S2CID 226230006 .

- ^ a b c d e Cai, Hongyun; Zheng, Vincent W .; Chang, Kevin Chen-Chuan (2 de febrero de 2018). "Un estudio completo de la incrustación de gráficos: problemas, técnicas y aplicaciones". arXiv : 1709.07604 [ cs.AI ].

- ^ a b Zhou, Sijin; Dai, Xinyi; Chen, Haokun; Zhang, Weinan; Ren, Kan; Tang, Ruiming; Él, Xiuqiang; Yu, Yong (18 de junio de 2020). "Sistema de recomendación interactivo a través del aprendizaje reforzado mejorado con el gráfico de conocimiento". arXiv : 2006.10389 [ cs.IR ].

- ^ Liu, Chan; Li, Lun; Yao, Xiaolu; Tang, Lin (agosto de 2019). "Una encuesta de algoritmos de recomendación basados en la incrustación de gráficos de conocimiento" . Conferencia internacional IEEE 2019 sobre informática e informatización educativa (CSEI) : 168-171. doi : 10.1109 / CSEI47661.2019.8938875 . ISBN 978-1-7281-2308-0. S2CID 209459928 .

- ↑ a b Sosa, Daniel N .; Derry, Alexander; Guo, Margaret; Wei, Eric; Brinton, Connor; Altman, Russ B. (2020). "Un método de incrustación de gráfico de conocimiento basado en la literatura para identificar oportunidades de reutilización de fármacos en enfermedades raras" . Simposio del Pacífico sobre Biocomputación. Simposio del Pacífico sobre Biocomputación . 25 : 463–474. ISSN 2335-6936 . PMC 6937428 . PMID 31797619 .

- ^ a b Níquel, Maximiliano; Tresp, Volker; Kriegel, Hans-Peter (28 de junio de 2011). "Un modelo de tres vías para el aprendizaje colectivo sobre datos multirrelacionales" . Actas de la 28th International Conference on International Conference on Machine Learning . ICML'11. Bellevue, Washington, Estados Unidos: Omnipress: 809–816. ISBN 978-1-4503-0619-5.

- ^ Níquel, Maximiliano; Tresp, Volker; Kriegel, Hans-Peter (16 de abril de 2012). "Factorizar YAGO: aprendizaje automático escalable para datos enlazados" . Actas de la 21ª conferencia internacional sobre World Wide Web . WWW '12. Lyon, Francia: Asociación de Maquinaria Informática: 271–280. doi : 10.1145 / 2187836.2187874 . ISBN 978-1-4503-1229-5.

- ^ a b c d e f g h i j Alshahrani, Mona; Thafar, Maha A .; Essack, Magbubah (18 de febrero de 2021). "Aplicación y evaluación de incrustaciones de gráficos de conocimiento en datos biomédicos" . PeerJ Ciencias de la Computación . 7 : e341. doi : 10.7717 / peerj-cs.341 . ISSN 2376-5992 . PMC 7959619 . PMID 33816992 .

- ^ a b c d e f g h i j k Wang, Meihong; Qiu, Linling; Wang, Xiaoli (16 de marzo de 2021). "Una encuesta sobre incrustaciones de gráficos de conocimiento para la predicción de enlaces" . Simetría . 13 (3): 485. Bibcode : 2021Symm ... 13..485W . doi : 10.3390 / sym13030485 . ISSN 2073-8994 .

- ^ a b Yang, Bishan; Yih, Wen-tau; Él, Xiaodong; Gao, Jianfeng; Deng, Li (29 de agosto de 2015). "Incorporación de entidades y relaciones para el aprendizaje y la inferencia en bases de conocimiento". arXiv : 1412,6575 [ cs.CL ].

- ^ a b c Trouillon, Théo; Welbl, Johannes; Riedel, Sebastián; Gaussier, Éric; Bouchard, Guillaume (20 de junio de 2016). "Embeddings complejos para predicción de enlaces simples". arXiv : 1606.06357 [ cs.AI ].

- ^ a b c d e Liu, Hanxiao; Wu, Yuexin; Yang, Yiming (6 de julio de 2017). "Inferencia analógica para incrustaciones multirrelacionales". arXiv : 1705.02426 [ cs.LG ].

- ^ a b c Kazemi, Seyed Mehran; Poole, David (25 de octubre de 2018). "Incrustación simple para predicción de enlaces en gráficos de conocimiento". arXiv : 1802.04868 [ stat.ML ].

- ^ a b c Níquel, Maximiliano; Rosasco, Lorenzo; Poggio, Tomaso (7 de diciembre de 2015). "Incrustaciones holográficas de gráficos de conocimiento". arXiv : 1510.04935 [ cs.AI ].

- ^ a b c d Balažević, Ivana; Allen, Carl; Hospedales, Timothy M. (2019). "TuckER: factorización de tensor para la finalización del gráfico de conocimiento". Actas de la Conferencia de 2019 sobre métodos empíricos en el procesamiento del lenguaje natural y la novena Conferencia conjunta internacional sobre el procesamiento del lenguaje natural (EMNLP-IJCNLP) : 5184–5193. arXiv : 1901.09590 . doi : 10.18653 / v1 / D19-1522 . S2CID 59316623 .

- ^ a b Ali, Mehdi; Berrendorf, Max; Hoyt, Charles Tapley; Vermue, Laurent; Galkin, Mikhail; Sharifzadeh, Sahand; Fischer, Asja; Tresp, Volker; Lehmann, Jens (29 de diciembre de 2020). "Traer luz a la oscuridad: una evaluación a gran escala de modelos de incrustación de gráficos de conocimiento en un marco unificado". arXiv : 2006.13365 [ cs.LG ].

- ↑ a b Wang, Zhen (2014). "Integración de gráficos de conocimiento mediante la traducción en hiperplanos" . Publicaciones AAAI, Vigésimo Octava Conferencia AAAI sobre Inteligencia Artificial .

- ^ Lin, Yankai; Liu, Zhiyuan; Sun, Maosong; Liu, Yang; Zhu, Xuan (25 de enero de 2015). "Embeddings de entidad y relación de aprendizaje para la finalización del gráfico de conocimiento" . Actas de la Vigésima Novena Conferencia de la AAAI sobre Inteligencia Artificial . AAAI'15. Austin, Texas: AAAI Press: 2181–2187. ISBN 978-0-262-51129-2.

- ^ a b c d e Ji, Guoliang; Él, Shizhu; Xu, Liheng; Liu Kang; Zhao, junio (julio de 2015). "Embebido de gráficos de conocimiento a través de matriz de mapeo dinámico" . Actas de la 53ª Reunión Anual de la Asociación de Lingüística Computacional y la 7ª Conferencia Conjunta Internacional sobre Procesamiento del Lenguaje Natural (Volumen 1: Artículos extensos) . Beijing, China: Asociación de Lingüística Computacional: 687–696. doi : 10.3115 / v1 / P15-1067 . S2CID 11202498 .

- ^ a b c d Xiao, Han; Huang, Minlie; Hao, Yu; Zhu, Xiaoyan (27 de septiembre de 2015). "TransA: un enfoque adaptativo para la incrustación de gráficos de conocimiento". arXiv : 1509.05490 [ cs.CL ].

- ^ a b c d e Nguyen, Dat Quoc; Sirts, Kairit; Qu, Lizhen; Johnson, Mark (junio de 2016). "STransE: un modelo novedoso de incorporación de entidades y relaciones en bases de conocimiento" . Actas de la Conferencia 2016 del Capítulo Norteamericano de la Asociación de Lingüística Computacional: Tecnologías del Lenguaje Humano . San Diego, California: Asociación de Lingüística Computacional: 460–466. arXiv : 1606.08140 . doi : 10.18653 / v1 / N16-1054 . S2CID 9884935 .

- ^ a b c d e f g Zhang, Wen; Paudel, Bibek; Zhang, Wei; Bernstein, Abraham; Chen, Huajun (30 de enero de 2019). "Integraciones de interacción para predicción y explicación en gráficos de conocimiento". Actas de la Duodécima Conferencia Internacional ACM sobre búsqueda web y minería de datos : 96–104. arXiv : 1903.04750 . doi : 10.1145 / 3289600.3291014 . ISBN 9781450359405. S2CID 59516071 .

- ^ a b c d Ebisu, Takuma; Ichise, Ryutaro (15 de noviembre de 2017). "TorusE: incrustación de gráfico de conocimiento en un grupo de mentiras". arXiv : 1711.05435 [ cs.AI ].

- ^ a b c d e Sol, Zhiqing; Deng, Zhi-Hong; Nie, Jian-Yun; Tang, Jian (26 de febrero de 2019). "RotatE: incrustación de gráfico de conocimiento por rotación relacional en espacio complejo". arXiv : 1902.10197 [ cs.LG ].

- ^ a b c d e f Dettmers, Tim; Minervini, Pasquale; Stenetorp, Pontus; Riedel, Sebastián (4 de julio de 2018). "Incrustaciones convolucionales de gráficos de conocimiento 2D". arXiv : 1707.01476 [ cs.LG ].

- ^ a b c d Jiang, Xiaotian; Wang, Quan; Wang, Bin (junio de 2019). "Convolución adaptativa para el aprendizaje multirrelacional" . Actas de la Conferencia de 2019 del Capítulo Norteamericano de la Asociación de Lingüística Computacional: Tecnologías del Lenguaje Humano, Volumen 1 (Artículos largos y breves) . Minneapolis, Minnesota: Asociación de Lingüística Computacional: 978–987. doi : 10.18653 / v1 / N19-1103 . S2CID 174800352 .

- ^ a b c d Nguyen, Dai Quoc; Nguyen, Tu Dinh; Nguyen, Dat Quoc; Phung, Dinh (2018). "Un modelo de incrustación novedoso para la finalización de la base de conocimientos basado en la red neuronal convolucional". Actas de la Conferencia de 2018 del Capítulo Norteamericano de la Asociación de Lingüística Computacional: Tecnologías del Lenguaje Humano, Volumen 2 (Artículos breves) : 327–333. arXiv : 1712.02121 . doi : 10.18653 / v1 / N18-2053 . S2CID 3882054 .

- ^ a b c d e Nguyen, Dai Quoc; Vu, Thanh; Nguyen, Tu Dinh; Nguyen, Dat Quoc; Phung, Dinh (6 de marzo de 2019). "Un modelo de incrustación basado en red de cápsula para la finalización del gráfico de conocimiento y la personalización de la búsqueda". arXiv : 1808.04122 [ cs.CL ].

- ^ a b c d e f Guo, Lingbing; Sun, Zequn; Hu, Wei (13 de mayo de 2019). "Aprender a aprovechar las dependencias relacionales a largo plazo en los gráficos de conocimiento". arXiv : 1905.04914 [ cs.AI ].

- ^ a b Toutanova, Kristina; Chen, Danqi (julio de 2015). "Características observadas versus latentes para la base de conocimientos y la inferencia de texto" . Actas del 3er Taller sobre modelos de espacio vectorial continuo y su composicionalidad . Beijing, China: Asociación de Lingüística Computacional: 57–66. doi : 10.18653 / v1 / W15-4007 . S2CID 5378837 .

- ↑ a b Mahdisoltani, F .; Biega, J .; Suchanek, Fabian M. (2015). "YAGO3: una base de conocimientos de wikipedias multilingües" . CIDR . S2CID 6611164 .

- ^ Hu, Weihua; Fey, Matthias; Zitnik, Marinka; Dong, Yuxiao; Ren, Hongyu; Liu, Bowen; Catasta, Michele; Leskovec, Jure (24 de febrero de 2021). "Open Graph Benchmark: conjuntos de datos para el aprendizaje automático en gráficos". arXiv : 2005.00687 [ cs.LG ].

enlaces externos

| Scholia tiene un perfil de tema para la incrustación de gráficos de conocimiento . |

![{\ displaystyle = {\ frac {| \ {q \ in Q: q <k \} |} {| Q |}} \ in [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cd0b504a6a4026009b8f5a0c39ad0ce4c88e5977)

![{\ Displaystyle MRR = {\ frac {1} {| Q |}} \ sum _ {q \ in Q} {\ frac {1} {q}} \ in [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/adf9b1771d7ac872c4d3082c26b15e8eb9f3e512)

![{\ Displaystyle {\ ce {[h; {\ mathcal {r}}]}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4754a8e29d7b4ccd4cf13de3052aef0922840171)

![{\ Displaystyle {\ ce {[h; {\ mathcal {r}}; t]}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/fb32c4cfc9fa12eb799777f7234990ce33b3d544)